神戸国際会議場で2024年3月11~15日に開催された言語処理学会第30回年次大会(NLP2024)にて,大橋(D1),周(D1),山下(D1),平井(M2),飯塚(M1),伊勢野(B4)の6名が参加しました.

学会について

今年の発表件数は599件(昨年:579)で,参加者数は2121名(昨年:1828)とどちらも過去最多でした.現地での発表がほとんどで,口頭発表の場合,質疑やコメントは主にSlack上で行われました.

自身の発表について

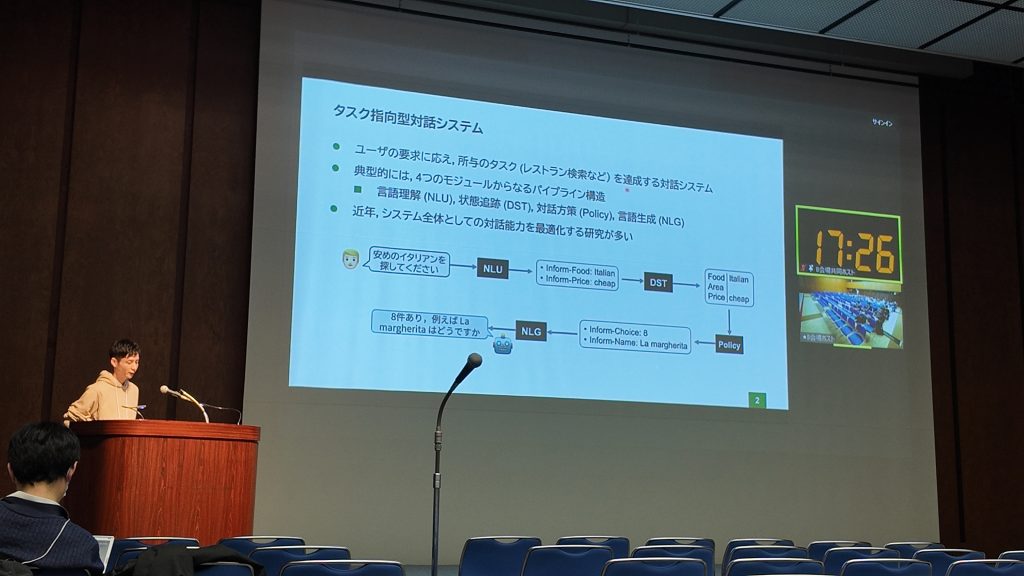

大橋は2件の発表を行いました.一つ目は,タスク指向型対話システムの応答文を修正するコンポーネントGenerative Post-processing Networksを強化学習によって最適化することで,タスク達成能力の向上を実現した研究についての発表です.二つ目は,日本語におけるタスク指向型対話データセットJMultiWOZに対して,新たに対話状態のアノテーションを付与することで,日本語における対話モデルのためのベンチマークを整備・評価した研究についての発表です.JMultiWOZは以下のページで公開しています.

https://github.com/nu-dialogue/jmultiwoz

生成的後処理ネットワークによるタスク指向型対話システムの最適化 Proceedings Article

In: 言語処理学会 第30回年次大会 発表論文集, 2024.

JMultiWOZに対する対話状態アノテーションの付与と対話システムの実装評価 Proceedings Article

In: 言語処理学会 第30回年次大会 発表論文集, 2024.

周は,キャッチコピー共同作成対話コーパスを分析した結果について発表しました.キャッチコピー共同作成対話は人間同士が対話を行いながらテキストボックス共同編集によりキャッチコピーを作成するタスクです.このコーパスについて,発話と編集および参照に着目した分析を行った結果について報告しました.

キャッチコピー共同作成対話コーパスにおける発話と編集および参照の分析 Proceedings Article

In: 言語処理学会 第30回年次大会 発表論文集, 2024.

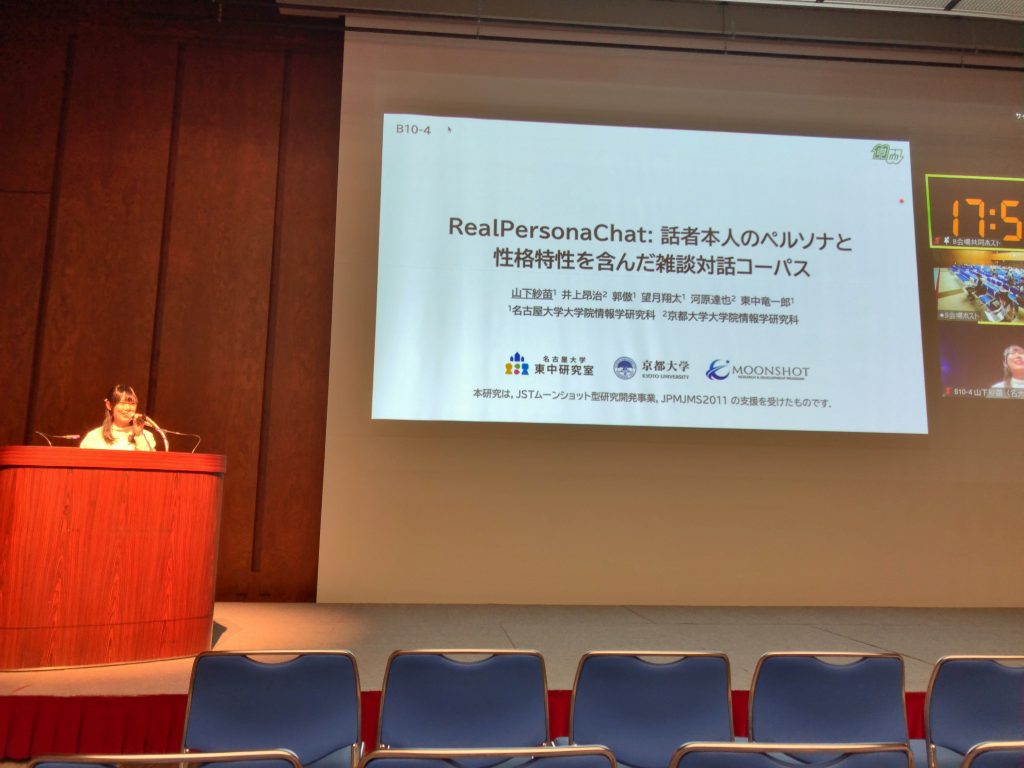

山下は,RealPersonaChat (RPC) コーパスについて発表しました.このコーパスは,話者の実際の性格特性やペルソナを含んだもので,14Kの日本語対話からなる,話者情報を含むコーパスとしては最大規模のものです.発表では,コーパスの収集方法や,発話に含まれるペルソナ情報の頻度を既存のコーパスと比較した結果を報告しました.また,筆頭著者である山下は若手奨励賞を受賞しました.RealPersonaChatは以下のページで公開しています.

https://github.com/nu-dialogue/real-persona-chat

RealPersonaChat: 話者本人のペルソナと性格特性を含んだ雑談対話コーパス Proceedings Article

In: 言語処理学会 第30回年次大会 発表論文集, 2024.

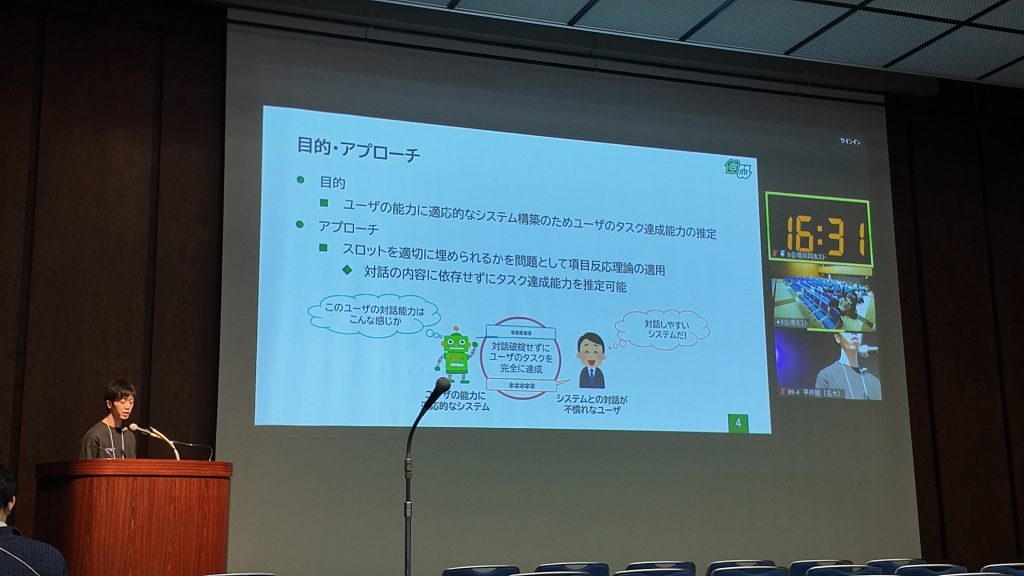

平井は,ユーザの対話能力に適応できるタスク指向型対話システムの実現の第一歩として,対話システムとの対話の中でユーザがタスクを達成するための能力を,項目反応理論を活用して推定する手法について発表しました.

タスク指向型対話システムへの項目反応理論の適用によるユーザのタスク達成能力の推定 Proceedings Article

In: 言語処理学会 第30回年次大会 発表論文集, 2024.

チュートリアル

合計で4名の方からのチュートリアルがありました:

- 岡崎 直観 先生(東京工業大学)

自然言語処理の基礎

新たに自然言語処理に従事する人を対象とし,単語の意味表現や言語モデルなどLLM時代でも重要な話題を取り上げながら,これまでの自然言語処理分野を振り返る講演でした.LLM時代の自然言語処理研究として「LLMから人間の知能に迫るような研究が登場するかもしれない」と言及されていた点が印象的でした.

- 北本 朝展 先生(ROIS-DS人文学オープンデータ共同利用センター/国立情報学研究所)

デジタル・ヒューマニティーズ入門

デジタル・ヒューマニティーズ(人文情報学)の分野における,自然言語処理の活用例が紹介されました.多くの機械学習モデルの学習データは,大部分が現代の日本語データであるため,古典的な機械可読データを増やす必要があるということが紹介されました.

- 松田 寛 先生(株式会社リクルート Megagon Labs)

作って学ぶ日本語大規模言語モデル

深層学習用ライブラリを用いた日本語LLMの構築手順およびLLMの内部構造について紹介されました.GitHubで公開されている実験ソースコードを実際に実行することもでき,より実践的な理解を深めることができました.

- 吉田 光男 先生(筑波大学)

計算社会科学入門

計算社会科学の分野における,自然言語処理の活用例が紹介されました.この分野で用いられるデータには,個人の行動のようなプライバシーに関わるものや性的指向といった倫理的な問題を含むものが多く存在し,研究する上ではそれらの扱いに問題が無いかについても考える必要があるということが紹介されました.

特別招待講演

合計で2名の方からの特別招待講演がありました:

- Kevin Knight 先生(Threeven Labs)

30 Years of Perplexity

30年にわたる自然言語処理に関する研究について,Knight 先生が当時持っていた考えを踏まえながら紹介されました.講演の中では,LSTMやTransformer,LLMの出現がこれまでの研究成果を大きく塗り替えたことが紹介されました.また,自身の研究以外にも,個人プロジェクトのような形で,自分がやりたいことに取り組む重要性も強調されました.

- 前川 喜久雄 先生(国立国語研究所)

これからの日本語研究と国立国語研究所:E3P-Linguisticsをめざして

ネット上の打ち言葉の定着,日本社会の多言語化,LLMなどAI技術の実用化により大きな変革期を迎えている日本語研究において,何を重視し,どのような方向を目指すべきかについての講演でした.新技術の出現に伴う定説の再検討の必要性や,日本社会の変化に対する実証的・定量的な調査の必要性について言及されていた点が印象的でした.

気になった発表

以下は我々が気になった発表です.

- A2-1 大規模言語モデルは自身の Hallucination を検知できるか?

門谷宙, 西田光甫, 西田京介, 齋藤邦子 (NTT)

大規模言語モデル(LLM)の問題として知られている Hallucination に関して,LLM 自身を文の真偽判定器として活用した際にどの程度検知できるかを調査した研究です.この検知率は LLM のパラメータに埋め込まれている知識量に依存することが明らかになり,Chain of Thought Prompting を用いることで検知率の上昇が確認されました. - B9-5 音声対話における応答速度改善に向けた先読み技術の検討

大萩雅也, 水本智也, 吉川克正 (SB Intuitions)

LLM を用いた対話システムでは、生成時間が原因で応答時間が長くなることが問題とされています.この問題に対してユーザ発話を先読みして応答候補を複数生成・保持し,素早い応答の実現を目指した研究です.実験では先読みがしやすい文脈であれば、一定の効果があることが確認されました.一方,先読みが難しい文脈では不自然な応答が生じる,という課題も発見されました. - P9-14 In-Context Learning においてLLMはフォーマットを学べるか

坂井吉弘, 趙羽風 (JAIST), 井之上直也 (JAIST/理研)

この研究では In-Context Learning で与えられるショットのフォーマットを LLM は暗黙的に学んでいるかを,語彙中の予測確率の順位に基づいて分析しています.結果としてショット数の増加に伴って評価ラベルの順位も向上していることから,LLM はショットによって答え方のフォーマットも学んでいることが判明しました. - A11-4 大規模言語モデルにおける評価バイアスの尤度に基づく緩和

大井聖也 (東工大), 金子正弘 (MBZUAI/東工大), 小池隆斗, Mengsay Loem, 岡崎直観 (東工大)

この研究では,LLM を評価器として用いた場合,評価対象文の生成尤度の高低が,実際の文評価にどのように影響するかを調査しています.結果として LLM には生成尤度の高いものを高く評価し,低いものを低く評価する尤度バイアスが存在することが判明しました.また,評価時に尤度の高い,または低いものに対して人間の評価を与えた事例をプロンプトに含めることで,この尤度バイアスが軽減されるということも判明しました.

おわりに

この1年は ChatGPT などの LLM の出現によって激動の1年だったと思います.そんな中で迎えた今回の NLP では「30年のプロンプトから未来を創造する」というスローガンのもと,これまでの歴史を振り返ることができました.LLMが多くの研究成果を塗り替える中で,「このような流れは過去にもあった.迷わずに今の自分の研究をしっかり続けることが重要である」というチュートリアル1での岡崎先生の意見は特に印象深く残りました.

今回の NLP では発表以外にも大規模な懇親会が開催され,同世代の研究者や企業の方とも交流する機会があり,大変充実した体験となりました.長崎で開催される来年の年次大会にもぜひ参加したいと思います.