中国の杭州で2025年10月20~25日に開催された The 2025 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS 2025) に,山下(D3)が参加しました.

基本情報

IROSは,知的ロボット分野における主要国際会議です.今年は投稿が4,381件(取り下げを除くと4,306件)あり,1,991件の論文が採択されました.採択率は46% (=1991/4306) でした.本会議のほかにも,ワークショップが82件,チュートリアルが3件,コンペが8件開催されるなど,非常に大規模な会議でした.

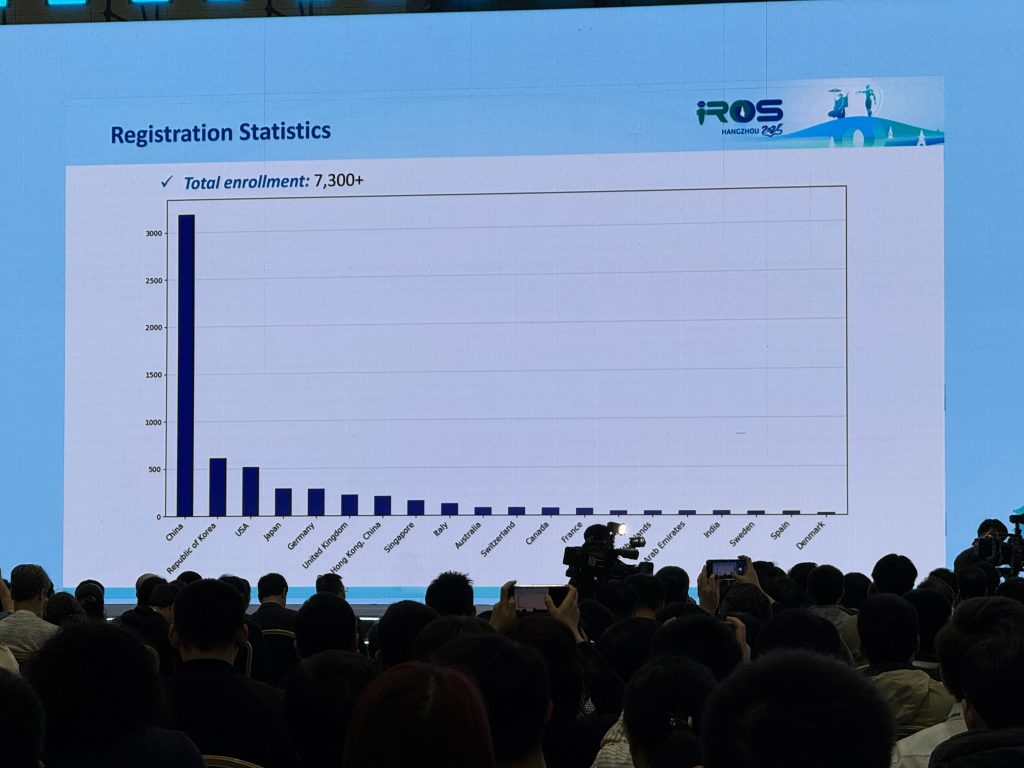

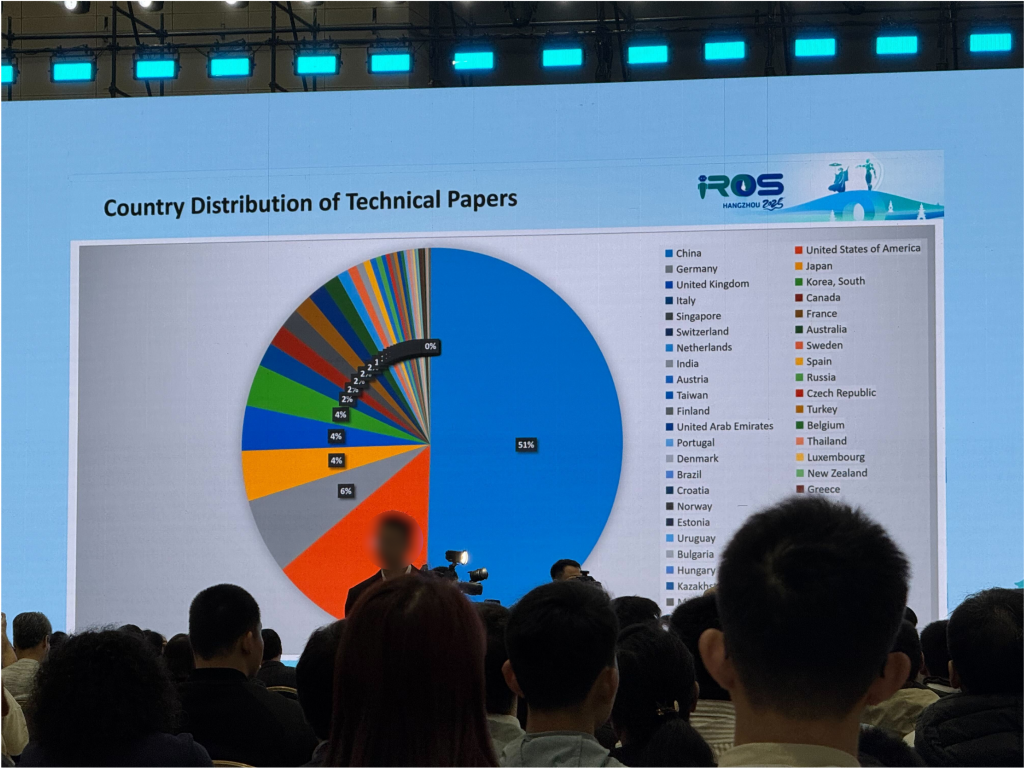

参加者は7,300人を超え,中国から3,000人以上,韓国とアメリカからそれぞれ500人以上,日本とドイツからはそれぞれ200人以上が参加しました.国・地域別の投稿状況は,中国が半分を占め,アメリカ,ドイツ,日本,イギリス,韓国と続きました.

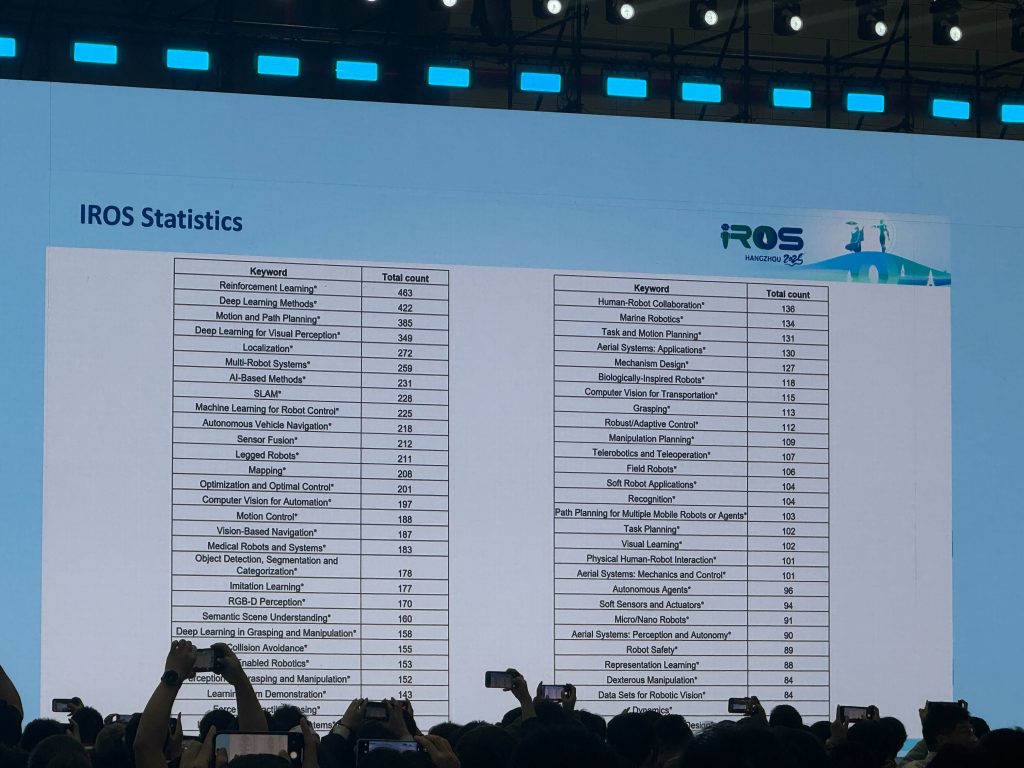

投稿情報から抽出したキーワードのトップ10は,Reinforcement Learning, Deep Learning Methods, Motion and Path Planning, Deep Learning for Visual Perception, Localization, Multi-Robot Systems, AI-Based Methods, SLAM, Machine Learning for Robot Control, Autonomous Vehicle Navigation であり,機械学習を用いて,視覚情報などを基にロボットや車を自動的に動作させる研究が中心的でした.

自身の発表

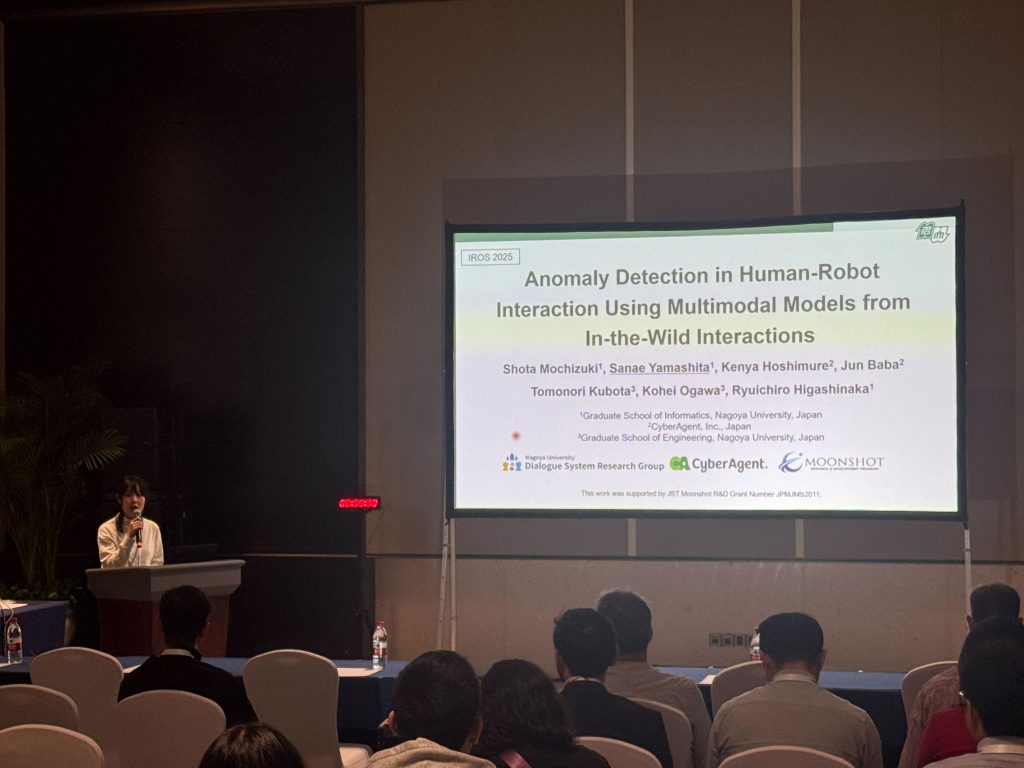

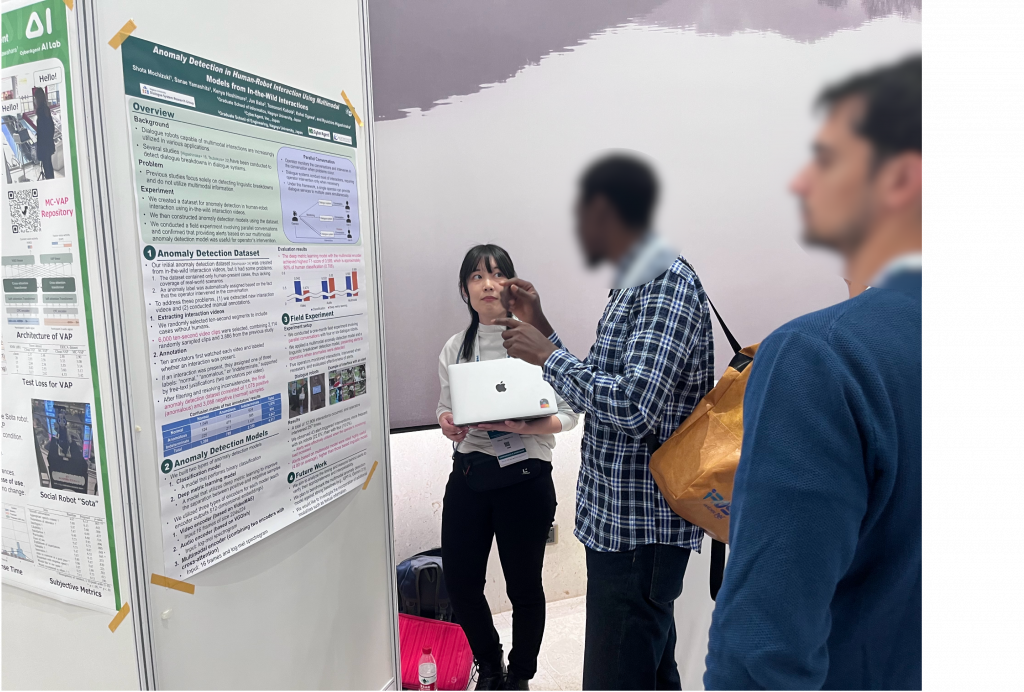

山下は,2日目の Human-Robot Interaction のセッションにて,人間とロボットの対話データセットを用いて対話破綻検出モデルを学習し,そのモデルを実証実験に適用した研究(筆頭は望月)の発表を行いました.発表形式は,冒頭でセッションの全員が5分間ずつ口頭発表を行い,その後一斉に40分間のポスター発表を行うというものでした.ポスター発表では,テキスト情報を用いずに対話破綻を検出しているのか,モデルのアーキテクチャはどうなっているのか,対話の長さはどれくらいか,何人くらいのユーザが映っているのかなどの質問をいただきました.限られた時間でしたが,多くの方と議論することができました.

Anomaly Detection in Human-Robot Interaction Using Multimodal Models Constructed from In-the-Wild Interactions Proceedings Article

In: 2025 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS2025), pp. 880–886, 2025.

Plenary session

Plenary sessionとして3件の講演がありました.

- TongBrain: Bridging Physical Robots and AGI Agents (Song-Chun Zhu. Peking University and Tsinghua University)

汎用人工知能 (Artificial General Intelligence; AGI) に関する講演です.発表者のチームは,視覚的なシーン理解,認知的推論,タスクプランニング,モーションプランニングなどを統合して,物理的かつ社会的に複雑なインタラクションを行うロボットの実現を目指しています.そのうち一つのプロジェクトがTongSimで,現実空間をスキャンして構築したシミュレーション空間で幼児を模したエージェント (TongTong) を行動させ,物理的な世界や感情を学習させることで,人間のように成長するエージェントを構築しました.今後は,街規模でのシミュレーションを通じて,人間とロボットの心の理論 (Theory of Mind; ToM) や社会的規範を理解することに取り組んでいくそうです. - The New Era of Mobility: Humanoids and Quadrupeds Enter the Real World (Marco Hutter. ETH Zurich)

二足および四足ロボットの自律性と運動能力を高めるための強化学習と自律制御に関する講演です.講演では,大量のロボットをシミュレーション環境で学習させたり,スイスの山岳地帯で四足ロボットに登山をさせる実証実験などが紹介されました.また,人間の動作データを取り入れることで強化学習における報酬設計の試行錯誤を減らすアイデアが紹介されました.具体的には,YouTubeなどの映像から人間の動作を抽出し,その動作をロボットに適用できるよう変換し,変換された動作をもとにポリシーを訓練した上で,最終的に実機ロボットに展開するというものです.今後は,これまで扱ってきたロボットよりもさらに大型の工事車両の自動化に取り組み,ロボットを労働力の一部として活用することを目指すそうです. - Autonomous Aerial Manipulation: Toward Physically Intelligent Robots in Flight (Hyoun JIN Kim. Seoul National University)

空中マニピュレーションロボットに関する講演です.空中マニュピレーションロボットは,飛行しながら物を掴んだり運んだりするため,安定した動作のためにはロボットの急な姿勢変化を抑制する必要があります.そのための制御手法が紹介されました.例えば,Free Flight (F) モードとObject Extraction (E) モードという2つのモードを切り替えるハイブリッドな制御手法があり,Fモードでは空力などの外乱を,Eモードでは接触時の反力を打ち消すような制御入力を加えることで,外乱や反力の影響を相殺します.モードを切り替える際には,次のモードの制御パラメータを事前に更新しておくことで急な姿勢変化を防ぎます.今後は,より知的に動作する空中マニピュレーションロボットを目指していくそうです.

ワークショップ

1日目と5日目はワークショップデーでした.山下は2つのワークショップに参加しました.

- Symbiotic Society with Avatars (SSA): Dynamic Remote Social Interactions Beyond Space and Time

アバターの遠隔操作や自律操作によって人間の能力を拡張しようとする,アバター共生社会に関するワークショップです.このワークショップでは,パーソナルアシスタントロボットの構築,移動型見回りロボットの遠隔操作,ロボット‐ユーザ間の関係の分析といった幅広い発表がありました.アバター共生社会に関する興味深い問題として,長時間の遠隔オペレーション対話で人間のオペレータが疲弊し,言葉遣いが乱雑になるという問題が挙げられていました.この問題に対処した研究では,オペレータの乱雑な発話の意図を予測して,その意図を保持したまま丁寧に言い換えることで,オペレータの負荷が下がることを実証していました. - Embodied AI and Robotics for Future Scientific Discovery

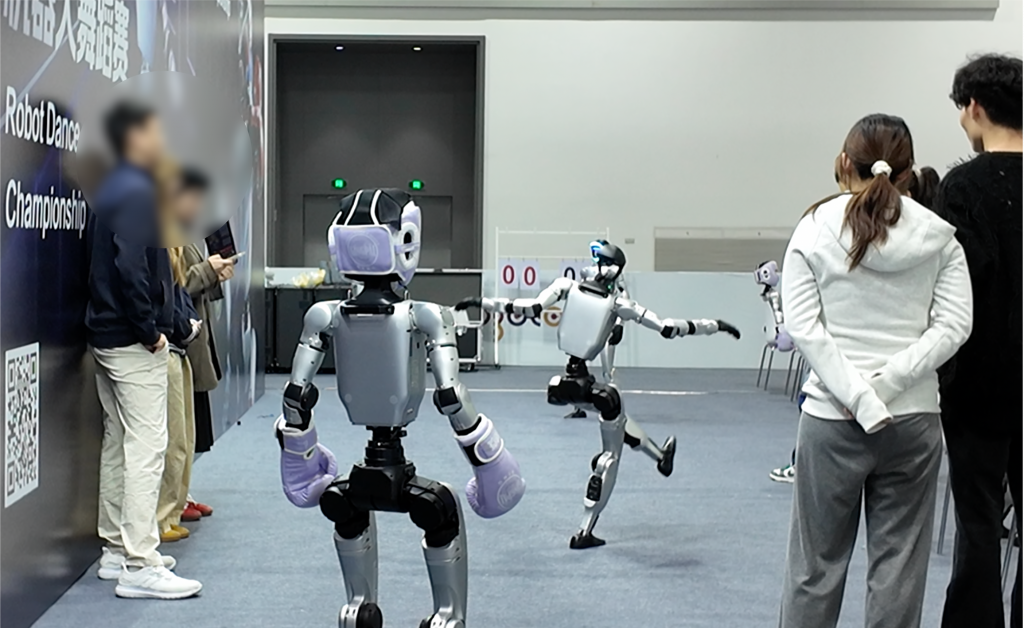

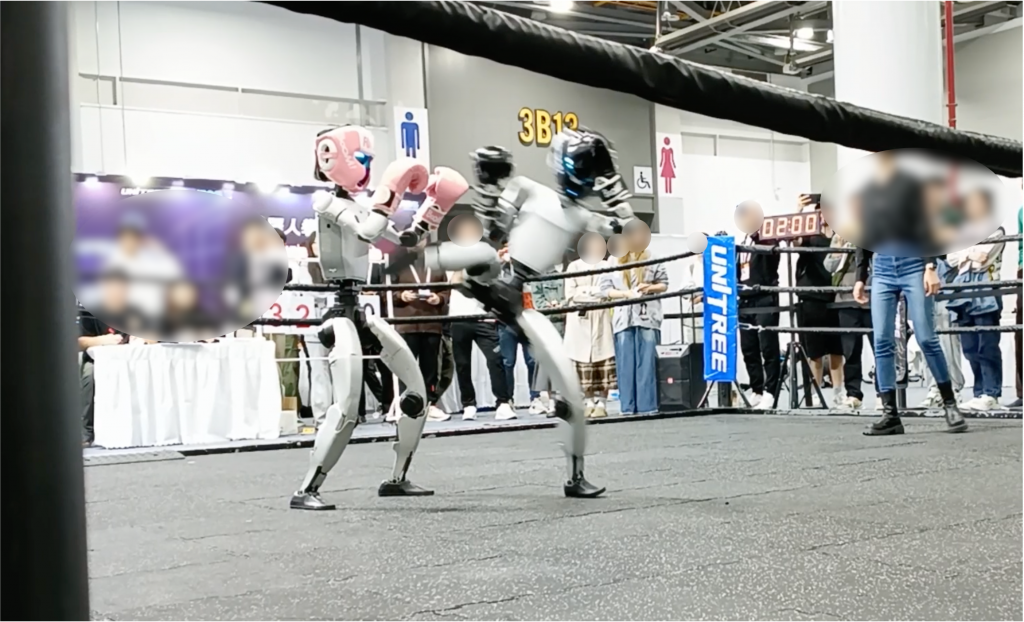

ロボットやAIを研究に活用することに関するワークショップです.このワークショップでは,複数のLLMエージェントにディスカッションをさせて物理学の問題を解かせた研究や,性格を持つロボットと人間による協力ゲーム中のインタラクションを分析した研究などが紹介されました.Unitree RoboticsのCEOの発表もあり,これまでに作ったロボットや,ロボットの動作を学習するために設計された世界モデルの紹介がありました.また,動く二足歩行ロボットが実現し,ロボットができる動き(走る,歩く,ジャンプする,踊る,ボクシングをする等)も十分に増えたことから,次のステップとしては小規模なデータセットで動作を学習するための方法をみんなで考えていくべきだという今後の展望が説明されました.

気になった発表

- Adapting Robot’s Explanation for Failures Based on Observed Human Behavior in Human-Robot Collaboration (Andreas Naoum and Parag Khanna)

人間と協働するロボットがタスク(棚に物を置く作業)を失敗した際に,その失敗理由の説明を,人間の反応に基づいて適応的に行う研究です.人の表情,視線,頭の動きなどの反応を取得したうえで,人間に混乱が生じたと判断した際には場合は詳細な説明を,人間の理解が進んだと判断した際には簡潔な説明を行うモデルを構築し,これが人間の混乱や苛立ちを軽減する効果があることを示しました. - SmartWay: Enhanced Waypoint Prediction and Backtracking for Zero-Shot Vision-and-Language Navigation (Xiangyu Shi, Zerui Li, Wenqi Lyu, Jiatong Xia, Feras Dayoub, Yanyuan Qiao, and Qi Wu)

自然言語の指示を理解して空間を案内する研究です.著者らが提案するSmartWayというフレームワークでは,大規模言語モデルを用いたナビゲータが,画像情報と自然言語の指示を共通の特徴空間にマッピングし,それらの文脈を踏まえて経路を予測します.さらに,指示との整合性や移動距離を評価し,誤った経路を検出すると自動的に戻るバックトラッキング機構を備えています.これらにより,SmartWayはゼロショット環境でも高精度な経路計画を行うことができました.

おわりに

IROSはロボットに関する世界最大規模の会議であるため,会場はお祭りのような雰囲気がありました.展示ブースでは賑やかな音楽が流れ,ロボットがフロアを歩き回り,踊り,ボクシングをしていました.特に,会場のある杭州に本社を置くUnitree Roboticsのロボット(二足歩行ロボットのG1や四足歩行ロボットのGo2)はあちこちで見かけました.ただし,動きながら対話をするロボットのデモは一つも見つけられず,この点はまだこれからという印象を受けました.

発表形式は口頭発表とポスター発表の2つでしたが,ポスターがメインだったため,参加者と十分に議論ができたと感じます.「自分の会社でも同じ問題に取り組んでいます」と声をかけてくれた参加者もおり,我々の研究に興味を持ってもらうことができたと思います.